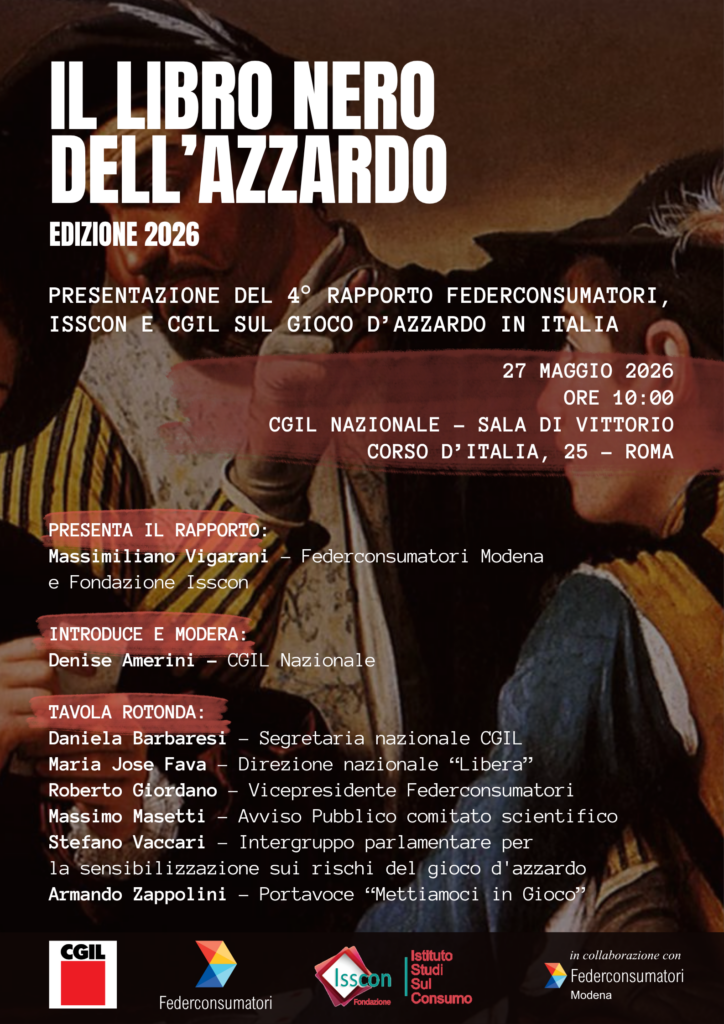

ChatGPT e la salute mentale, più di 1 milione di persone manifesta intenzioni suicide col chatbot (Foto Sanket Mishra per Pexels)

ChatGPT, 1 mln di persone con intenzioni suicide quando chatta

OpenAI pubblica un post nel quale spiega di aver collaborato con esperti di salute mentale per aiutare ChatGPT a riconoscere i segnali di disagio mentale e le intenzioni di suicidio. The Guardian: oltre 1 milione di persone a settimana manifesta piani o intenzioni suicide quando chatta

Più di un milione di persone a settimana manifesta intenzioni suicide quando conversa con ChatGPT. Mentre lo 0,07% degli utenti attivi in una settimana, una stima di circa 560 mila, mostra “possibili segni di emergenze di salute mentale legate a psicosi o mania”. È quanto afferma un approfondimento del The Guardian sulla base di un post di OpenAI che affronta le conversazioni sensibili su ChatGPT e illustra i frutti di un recente aggiornamento del modello per migliorare le risposte del chatbot.

Salute mentale, suicidio, dipendenza emotiva

Sintomi di salute mentale, conversazioni che rivelano tendenze all’autolesionismo e al suicidio, dipendenza emotiva dall’intelligenza artificiale sono i rischi che OpenAI affronta, spiegando che il suo recente aggiornamento GPT-5 ha migliorato la sicurezza degli utenti.

Nel suo post, OpenAI afferma di aver collaborato con oltre 170 esperti di salute mentale per aiutare ChatGPT a riconoscere in modo più affidabile i segnali di disagio, rispondere con attenzione e guidare le persone verso un supporto concreto, riducendo così del 65-80% le risposte che non rispecchiano il comportamento desiderato. L’aggiornamento avrebbe insegnato al modello a “riconoscere meglio la sofferenza, a gestire le conversazioni in modo più fluido e a indirizzare le persone verso l’assistenza professionale quando appropriato”.

“Sintomi di salute mentale e disagio emotivo sono universalmente presenti nelle società umane e, grazie alla crescente base di utenti, una parte delle conversazioni di ChatGPT include queste situazioni”, si legge nel post.

Autolesionismo e suicidio

OpenAI dichiara di aver ampliato il lavoro sulla prevenzione di autolesionismo e suicidio, un’area difficile da rilevare e che rimane oggetto di ricerca e studio. “Addestriamo i nostri modelli a rispondere in modo sicuro, anche indirizzando le persone verso risorse professionali come le linee di assistenza telefonica per le crisi”.

L’analisi iniziale “stima che circa lo 0,15% degli utenti attivi in una determinata settimana abbia conversazioni che includono indicatori espliciti di potenziale pianificazione o intento suicida e lo 0,05% dei messaggi contiene indicatori espliciti o impliciti di ideazione o intento suicida”.

Nelle conversazioni su autolesionismo e suicidio, l’aggiornamento del modello ha ridotto le risposte indesiderate del 52%, spiega ancora OpenAI, aggiungendo che “in una valutazione del modello composta da oltre 1.000 conversazioni impegnative su autolesionismo e suicidio, le nostre nuove valutazioni automatizzate hanno assegnato al nuovo modello GPT-5 un punteggio pari al 91% di conformità con i comportamenti desiderati, rispetto al 77% del precedente modello GPT-5”.

Salute mentale e dipendenza emotiva

Un’altra area affrontata è quella dei gravi sintomi di salute mentale. Sono conversazioni difficili da rilevare, spiega il post, ma l’analisi stima che “circa lo 0,07% degli utenti attivi in una determinata settimana e lo 0,01% dei messaggi indichino possibili segnali di emergenze di salute mentale legate a psicosi o mania”.

Altro settore di intervento riguarda, ancora, la dipendenza emotiva dall’intelligenza artificiale. Secondo le stime, “circa lo 0,15% degli utenti attivi in una determinata settimana e lo 0,03% dei messaggi indicano livelli potenzialmente elevati di attaccamento emotivo a ChatGPT”.

Chatbot e salute

Il tema della salute mentale e del ruolo svolto dai chatbot quando vengono usati da chi ha disturbi, o addirittura in sostituzione di terapie, è di particolare rilevanza, così come il ruolo svolto dai chatbot quando diventano “amici” e compagni dei bambini. Lo scorso settembre, negli Usa, la Federal Trade Commission ha avviato un’indagine nei confronti di sette aziende che forniscono chatbot basati sull’intelligenza artificiale rivolti ai consumatori, chiedendo informazioni su come queste misurano, testano e monitorano i potenziali impatti negativi della tecnologia su bambini e adolescenti.

“I chatbot basati sull’intelligenza artificiale – spiega la FTA – possono imitare efficacemente caratteristiche, emozioni e intenzioni umane e, in genere, sono progettati per comunicare come un amico o un confidente, il che può indurre alcuni utenti, soprattutto bambini e adolescenti, a fidarsi e a instaurare relazioni con i chatbot”.

L’indagine vuole capire quali misure le aziende adottino per valutare la sicurezza dei loro chatbot quando comunicano con bambini e adolescenti, per limitare gli effetti negativi e per informare i genitori dei rischi.

A chi chiedere aiuto

Se sei in una situazione di emergenza e pericolo imminente, chiama il numero di emergenza 112. Se tu o una persona che conosci ha pensieri suicidi, puoi chiamare il Telefono Amico allo 02 2327 2327 oppure WhatsApp Amico 324011 7252. Puoi inoltre chiamare l’associazione Samaritans al numero 06 77208977, tutti i giorni dalle 13 alle 22.